Оптимизация BIOS для Intel Xeon: настройки производительности

Оптимизация BIOS для Intel Xeon: настройки производительности звучит как задача для инженера, но на деле это чаще искусство маленьких, точных шагов. Чаще всего внимание концентрируется на балансе между скоростью, энергопотреблением и стабильностью под реальной рабочей нагрузкой. В такой системе каждый параметр имеет свою историю: от того, как распределяются задачи между кристаллами в NUMA-распределении, до того, как энергопотребление влияет на турбовую частоту в горячих условиях. В этой статье мы разложим по полочкам подход к настройке BIOS, чтобы вы получили реальный прирост производительности без риска «проседания» системы.

Понимание архитектуры Xeon и базовые принципы настройки

Xeon сегодня особенно интересен за счет многоядерности, поддержки ECC памяти и возможности масштабирования в многокартных конфигурациях. В этом контексте BIOS становится не столько кнопкой ускорения, сколько инструментом для выравнивания возможностей процессора и памяти под конкретную задачу. Важны пары слов: NUMA, энергопотребление, Turbo и режимы питания. Понимание того, как эти механизмы взаимодействуют, поможет не тратить время на бессмысленные изменения. В реальности работа с Xeon требует оценки workload: базы данных, виртуализация, машинное обучение или контейнеризированные сервисы — каждый сценарий предъявляет свои требования к задержкам и пиковой мощности.

Перед любыми изменениями полезно зафиксировать базовую конфигурацию: какие памяти задействованы, сколько каналов используется, есть ли несколько процессоров и как они обмениваются данными. Это позволяет затем корректно оценить эффективность изменений. Важный момент: на серверных платформах часто критично сохранить устойчивость и корректность работы памяти и периферии. Поэтому любое изменение — лучше пошагово и с тестами, чем «громко» и наугад.

Ключевые параметры BIOS, влияющие на производительность

Для Xeon главные цели — максимальная предсказуемость и эффективная турбодача в рамках заданного энергопотребления. Рассуждать нужно не языком «мощности на пик» в лоб, а тонко подбирать режимы C- и P-States, частоты и лимиты мощности. Ниже приведены параметры, которые чаще всего дают ощутимый эффект и требуют аккуратности при настройке.

В арсенал следует включать контроль над энергопитанием, памятью и режимами работы процессора. Некоторые параметры работают прямо в связке, поэтому изменения одного могут влиять на другое. Прежде чем трогать настройки, полезно сделать тестовую прогонку под реальной нагрузкой и сравнить результаты до и после коррекции. В процессе сохраняйте резервные копии конфигураций — BIOS может упрямо возвращаться к дефолту после неудачной операции.

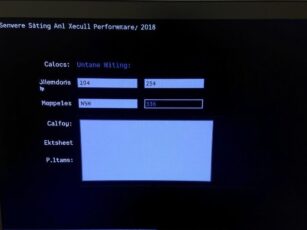

| Параметр | Эффект |

|---|---|

| C-States | Управление состояниями сна процессора. Правильная настройка снижает энергопотребление в простое, но может влиять на латентность при высоких нагрузках. |

| P-States / Turbo | Баланс между базовой частотой и турбонаддувом. Установка агрессивного Turbo может увеличить пиковые задержки, но дать прирост в реальных задачах. |

| PL1 / PL2 | Лимиты мощности для устойчивой частоты. PL1 — длительный лимит, PL2 — временный. Их настройка влияет на то, как долго CPU может держать высокие частоты. |

| Тайминги памяти, частота DDR | Чем выше скорость и ниже задержки памяти, тем лучше пропускная способность, но требования к совместимости и стабильности выше. |

| NUMA-распределение | Распределение задач по узлам памяти. Неправильное распределение может привести к задержкам и снижению пропускной способности. |

Понимание этих параметров поможет корректно выстроить базовую конфигурацию и затем наглядно увидеть эффект от каждой правки во время тестирования. Важная мысль: не существует одной «идеальной» настройки для всех сценариев. Оптимизация BIOS для Intel Xeon: настройки производительности — это поиск баланса между задачей, на которой вы фокусируетесь, и стабильностью системы.

Элементы базовой конфигурации

Начальный набор параметров, которые обычно стоит проверить при входе в BIOS на Xeon-сервере. Установите их в безопасный режим, затем повышайте устойчивость по мере необходимости и возможности тестового контроля. В первую очередь проверьте режим работы процессора, поведение Turbo, лимиты мощности и режим потребления памяти. Далее можно добавить контроль над энергопотреблением в зависимости от конкретной нагрузки: базовую частоту, при которой система должна стабильно работать, и верхнюю точку для пиковой активности.

Практические шаги по настройке: от базовых до продвинутых

Если вы делаете первые шаги в настройке BIOS на Xeon, полезно выстроить план: сначала — безопасное обеспечение оборудования, затем — тест по нагрузке, затем — постепенное увеличение производительности. Такой подход позволяет избежать перегрева и нестабильности. В практике важно фиксировать результаты тестов с каждого этапа, чтобы увидеть конкретный эффект и не терять дорожку в ходе экспериментов.

Начните с простого — ограничьте энергопитание до PL1 и PL2 в разумных пределах и проверьте стабильность. Затем подберите режим питания C-States так, чтобы система не теряла отклик в рабочих задачах, но экономила энергию в периоды низкой активности. Далее настройте частоты и режим Turbo, ориентируясь на характер нагрузки: базы данных и вычислительные сервисы обычно выигрывают от плавной турбонаддувы в пределах заданного лимита мощности.

- Сделайте резервную копию текущей конфигурации BIOS и записывайте исходные значения параметров. Это поможет вернуть систему к исходной точке при необходимости.

- Установите PL1 и PL2 в разумные пределы, исходя из спецификаций процессора и кулера. Начните с умеренных значений и тестируйте на реальных задачах.

- Включите Turbo и проверьте поведение частоты под тяжелой нагрузкой. Уменьшайте или увеличивайте порог турбо в зависимости от реального времени реакции системы и температуры.

- Настройте режим памяти: частоты, тайминги и профиль Memory. Учитывайте совместимость модулей и требования ECC. После изменений проведите стресс-тест памяти и процессора.

- Проверяйте NUMA-распределение задач, если сервер использует несколько процессов. Включение корректного распределения поможет снизить задержки доступа к памяти.

Практический пример: на тестовом сервера с двумя процессорами Xeon S-design вы увидели, что увеличение PL2 на 10% без повышения температуры не привело к устойчивому росту производительности. Это говорит о том, что узким местом скорее стал задержку доступа к памяти или баланс по NUMA, а не просто турбина. В таком случае полезно переключиться на более точечную настройку памяти и перераспределение задач между узлами.

Оптимизация питания и температур: как не перегреть систему, но получить скорость

Эффективная оптимизация процессора невозможна без контроля температурного режима. Что полезно помнить: Xeon может держать высокие частоты под турбо, но только если системе удается обеспечить достаточно теплоотвода. Поэтому ключевые шаги — это согласование теплообмена, мощности и частот. Ставя цели, ориентируйтесь на стабильную работу при максимальной нагрузке в течение нескольких часов.

Чтобы не перегреть сервер, используйте мониторинг в реальном времени: датчики температуры, вентиляторы и их скорость вращения, а также значения потребления мощности в реальном времени. Коррекция частот должна идти синхронно с изменением температуры. При этом избегайте чрезмерных изменений за один шаг: лучше несколько небольших пороговых изменений и повторная проверка системы под нагрузкой.

Автоматизация управления питанием

Современные BIOS часто предлагают режимы автоматизации: интеллектуальное управление скоростью вентиляторов, адаптивные лимиты мощности и динамическое регулирование частот. Пользоваться ими можно, но в корпоративной среде они часто требуют доработки под конкретный стенд. В любом случае автоматизация может стать хорошим помощником: она снимает часть рутины, сохраняет стабильность и снижает риск человеческой ошибки.

Настройка памяти и NUMA: чтобы данные доходили быстро

Одной из самых важных тем в настройке Xeon является распределение памяти и правильная работа сNUMA-архитектурой. В многопроцессорных конфигурациях задержки доступа к памяти могут быть критичны. Неправильное распределение задач между узлами памяти приводит к тому, что процессор работает «вокруг» памяти, а не «с доступом к близкой памяти» — это заметно снижает реальную производительность.

Для грамотной настройки полезно задействовать режим NUMA-оптимизации в BIOS и по возможности закреплять ресурсы под задачи. Также не забывайте про ECC-память, особенно в базах данных и виртуализации: корректность и целостность данных важнее, чем минимальная задержка в отдельных потоках. В реальности хорошие балансы достигаются через грамотную настройку частот памяти, профилей и совместимости модулей.

Мониторинг и тестирование эффективности

Проверка результатов — не менее важная часть процесса, чем сами настройки. Рекомендуется сочетать синтетические тесты и реальные рабочие нагрузки. Синтетика показывает, как система функционирует в предсказуемой среде, а реальные тесты — как она ведет себя в ваших сценариях. В общих чертах это выглядит как серия замеров до и после изменений по ключевым метрикам: задержки, пропускная способность, время отклика и температура.

Для мониторинга используйте комбинацию инструментов: системный мониторинг на уровне BIOS-логов, утилиты производительности сервера и профиль тестирования. Примеры решений: утилиты для Linux и Windows, утилиты fabricante, а также внешние скрипты для автоматического сравнения результатов. Важно фиксировать начальные значения и затем сравнивать их после каждого этапа настройки.

Распространенные ошибки и как их избежать

К числу частых промахов относятся чрезмерный форс частот без должного теплоотвода, слишком агрессивные лимиты мощности, неоптимизированное распределение памяти и пренебрежение NUMA. Все эти шаги могут привести к нестабильной работе или ложному улучшению производительности. Ещё одна распространенная ошибка — не тестировать изменения на реальной рабочей нагрузке, опираясь только на теоретические показатели. Результаты в условиях стенда без реальных задач часто даны в искажении.

Чтобы снизить риск, выполняйте последовательную валидацию: после каждого изменения проводите минимум 2–3 часа под нагрузкой и фиксируйте температуру, потребление и latency. Не забывайте про резервное копирование и возможность отката к исходной конфигурации. В конце концов, подход к оптимизации BIOS для Intel Xeon: настройки производительности — это не про максимальную частоту, а про устойчивость и предсказуемость работы под конкретной задачей.

Итоги и рекомендации

Подводя итоги, можно сказать: эффективная оптимизация BIOS для Xeon требует систематического подхода и внимательного контроля за температурой, энергопотреблением и задержками доступа к памяти. В итоге вы получите систему, которая не пытается во что бы то ни стало «выжать» максимальную частоту, а демонстрирует реальный рост производительности в ваших рабочих сценариях. Разумная настройка включает базовые параметры мощности, аккуратную работу с частотами и памятью, корректную работу NUMA и тщательное тестирование на практике.

Я сам по опыту могу отметить, что первые шаги лучше начинать с ясной цели: какую задачу мы решаем — это база для всех последующих изменений. Удалось добиться ощутимого прироста в обработке запросов БД и в виртуализации после того, как мы сбалансировали PL1/PL2 и перенастроили распределение памяти между узлами. Важно помнить: не существует единой «настройки под все» — каждый стенд требует индивидуального подхода и последовательности шагов. Только так вы получите стабильную, предсказуемую и быструю систему на базе Intel Xeon, которая будет работать именно так, как задумано.

Замечания по личному опыту

В своей практике я сталкивался с двумя кейсами, когда последовательная настройка BIOS привела к заметному улучшению. В одном случае мы добились устойчивого прироста пропускной способности базы данных за счет аккуратной настройки NUMA и умеренного увеличения частот памяти. В другом случае мы нашли оптимальное сочетание режимов C-States и Turbo, что снизило латентность в виртуальных машинах без перегрева сервера. Эти примеры подтверждают, что системный подход, тестирование и документирование изменений — ключ к успешной оптимизации.