Сборка высокодоступного сервера: принципы отказоустойчивости

Создание сервера, который продолжает работать без заметных сбоев даже при поломке отдельных узлов или сетевых линий, — задача не из простых. Здесь важно не просто собрать мощные железные детали, но и спроектировать систему так, чтобы отказ одной детали не превращался в простой простоя сервиса. В этой статье мы разберем принципы, подходы и практические шаги, которые помогают превратить обычный сервер в устойчивый кромке сбоя инфраструктурный узел. Вы узнаете, какие архитектурные решения действительно работают на практике, какие параметры контроля за состоянием критически важны, и как довести концепцию до реального промышленного уровня. Все это пригодится тем, кто планирует сборку высокодоступного сервера, ориентированного на стабильную работу в долгую эпоху.

Что такое высокодоступность и зачем она нужна

Высокая доступность — это способность сервиса возвращаться к нормальной работе после любого сбоя за минимальное время. Речь не о стопроцентной безотказности, но о снижении downtime до приемлемых величин. В контексте бизнеса это значит, что даже при внешних неполадках клиенты не ощутят падения сервиса и не уйдут к конкурентам. Важна не только скорость восстановления, но и предсказуемость реакции системы на различные типы сбоев.

Параметры RPO и RTO становятся ориентиром для проектирования. RPO обозначает допустимую потерю данных, а RTO — время, за которое сервис восстанавливается после аварии. В разных сценариях они будут разными: у финансовых приложений требования выше, чем у архивного сервиса. Но в любом случае задача состоит в том, чтобы выбрать оптимальный баланс между стоимостью и уровнем доступности, который отвечает потребностям бизнеса и пользователей.

Архитектура отказоустойчивости: принципы и компромиссы

Ключ к устойчивости — избыточность по разным уровням: ресурсы, сети, хранение, и программная логика. Существуют базовые конфигурации, которые широко применяются на практике: активная активная, активная пассивная, а также варианты с геораспределением и распределением нагрузки. В каждом случае важны решения по синхронной или асинхронной репликации, согласованию состояний и управлению консенсусом между узлами.

Чтобы системно подойти к выбору, полезно увидеть наглядные примеры и их tradeoffs. Ниже приведена краткая таблица с типами конфигураций и их особенностями:

| Вариант | Особенности | Когда применим | Риски |

|---|---|---|---|

| Активная пассивная | Основной узел обслуживает трафик, резервный в режиме ожидания | Деплой, где важна простота управления и экономия ресурсов | Убийственные задержки при переключении, если управление не автоматизировано |

| Активная активная | Несколько узлов обрабатывают запросы одновременно | Высокая пропускная способность и минимизация downtime | Сложнее синхронизация, риск разделения мозга в случае сетевых проблем |

| N+1 и выше | Избыточность по компонентам, запасной элемент может включаться мгновенно | Критичные сервисы, где простоя недопустим | Повышенная стоимость и сложность управления |

| Геораспределение | Репликация в разных дата-центрах, синхронная или асинхронная | Защита от локальных аварий и стихий | Задержки между локациями, сложность сетевого взаимодействия |

Выбор конкретной конфигурации зависит от требований к задержке, пропускной способности и бюджету. В реальной сборке может оказаться целесообразным сочетать несколько подходов:, например, активная пассивная пара в одном дата-центре и георезервирование для аварийного переключения на другой регион. Важно заранее смоделировать сценарии отказов и проверить, как система реагирует на них в тестовой среде.

Аппаратная основа: что должно быть лишено риска

Глубокая избыточность начинается с оборудования. Важны резервируемые источники питания, hot-swappable диски, двойные материнские платы в составе одного блока и качественные сетевые карты с поддержкой агрегации каналов. Непрерывность питания лучше всего обеспечивают ИБП с автоматическим переключением и возможность синхронной подзарядки аккумуляторов. Именно такие детали снижают вероятность потери данных и сбоя сервиса в результате перебоев в электропитании.

Сетевой стек требует особого подхода. Наличие нескольких NIC по каждому узлу, поддержка NIC teaming или Link Aggregation позволят держать трафик в устойчивом режиме даже во время выхода из строя одного канала. В качестве Storage можно рассмотреть несколько протоколов и вариантов: локальные диски с RAID, сетевые хранилища и репликацию по нескольким узлам. Важна согласованная политика кэширования и последовательности записи для предотвращения потери данных в случае отказа узла.

Хранение данных — особая глава. В зависимости от требований можно выбрать RAID уровня 1/10 для балансированной надёжности или более продвинутые схемы вроде RAID 6/60, а также ZFS или другие гибридные решения с копированием и дедупликацией. Модель с репликацией между узлами поможет снизить риск потери данных в случае выхода из строя одного сегмента инфраструктуры. В любом случае стоит продумать план очередности переключения узлов и скоростной лимит при восстановлении после сбоя.

Программная часть: ОС, инструменты и оркестрация

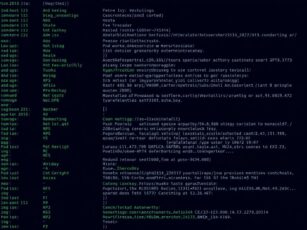

Устойчивость не рождается из железа. Она требует продуманной операционной системы и программной начинке, которая поддерживает автоматическое переключение и мониторинг. В Linux-средах часто применяют Pacemaker и Corosync для координации кластера, Keepalived — для балансировки и фейловер между экземплярами, а также инструменты уровня виртуализации — KVM или контейнеризации — для изоляции сервисов. Важна прозрачная интеграция мониторинга, чтобы система сама отправляла оповещения в случае отклонений и восстанавливала состояние без ручного участия.

Мониторинг — сердце устойчивой инфраструктуры. Надежные платформы, такие как Prometheus и Grafana, позволяют увидеть состояние узлов, задержки и пропускную способность в динамике. Настройка алертирования по порогам и автоматизированного запуска ремонтных процедур снижает время реакции на инциденты. Важна и стратегия резервного копирования конфигураций и секретов, чтобы быстро восстановить кластер после киберугроз или технической ошибки админа.

Также полезно рассмотреть интеграцию виртуализации и контейнеризации в рамках отказоустойчивых сценариев. В среде с KVM можно организовать гибкие группы узлов, миграцию виртуальных машин и быстрое разворачивание новых экземпляров. Контейнерные решения, такие как Kubernetes, добавляют уровень оркестрации, который помогает автоматизировать масштабирование и перераспределение нагрузки между узлами в случае перегрузок или выхода оборудования из строя.

География размещения и распределение нагрузки по пространству

Географическая отказоустойчивость зачастую становится ключевым элементом для критически важных сервисов. Размещение узлов в разных дата-центрах с минимальными задержками между ними требует понимания сетевых маршрутов и согласованных политик репликации данных. Синхронная репликация между регионами почти всегда ограничена задержками, поэтому многие проекты выбирают асинхронную репликацию на втором регионе и синхронную внутри одного центра. Такой подход позволяет сохранить приемлемый RPO при разумной цене за качество связи.

Локальные и глобальные сети должны быть построены так, чтобы устранить «одностороннюю» точку отказа. Внутренние VLAN и корректная сегментация сетей помогают ограничить влияние проблем в одном сегменте на весь кластер. Важно обеспечить согласованные политики резервирования — например, для корневого сервера аутентификации, хранилища данных и контрольной плоскости управления кластером. График задержек между узлами не должен превысить заданный порог для критических транзакций, чтобы переключение происходило прозрачно для пользователей.

Практические шаги сборки: пошаговый подход

Проектирование начинается не в тот момент, когда приходит оборудование, а еще на этапе моделирования сценариев. Определите требования к доступности, величины RPO и RTO, а также бюджет на оборудование и лицензии. Затем следует выбрать архитектуру: активная пассивная или активная активная, возможно с георезервированием. Важна ясная дорожная карта и тестовый план, который охватывает не только базовый функционал, но и редкие сбои, например, перегрузку сети или отказ одного центра.

- Сформулируйте требования к каждому слоям: сеть, хранение, вычислительная часть, управление и мониторинг. Опишите, какие узлы необходимы в каждом уровне и какие сценарии будут считаться нормой.

- Сделайте карту конфигураций и зависимостей. Включите список компромиссных решений, например, какие потери данных допустимы при дистанционной репликации.

- Закупите комплектующие и оборудование с запасом. Включите в запас не только запасной узел, но и запасной блок питания, кабели и быстрые пути к установке обновлений.

- Разверните тестовую среду и проведите серию тестов: фейловер, нагрузочное тестирование, тесты восстановления после сбоев и сценарии кибератак. В ходе тестирования документируйте результаты и корректируйте конфигурацию.

- Внедрите автоматизированные процессы развертывания и обновления. Скрипты установки, оркестрация и хранение конфигураций должны быть идентичны в тестовой и рабочей среде для минимизации риска ошибок.

- Поставьте на контроль все критичные параметры: треки задержек, потери пакетов, статус дисков, температуру и потребление энергии. Настройте алерты так, чтобы уведомления приходили в нужный канал без шума.

После каждого этапа следует возвращаться к проверке бизнес-требований. Необходимо удостовериться, что новая конфигурация укладывается в лимиты по бюджету, обеспечивает желаемый уровень доступности и не требует чрезмерной сложности в эксплуатации. Любая система, которая требует постоянного ручного вмешательства, рискует стать источником новых ошибок, поэтому автоматизация становится не просто приятной опцией, а жизненно важной частью проекта.

Типичные проблемы и как их обходить

Часто в проектах сталкиваются с ложными срабатываниями мониторинга, задержками в сетях, а также с проблемами совместимости между компонентами. Хорошо продуманная архитектура снижает риск: скоординированные правила тревог, четко определить пороги производительности и заранее прописать процедуры реагирования на инциденты. Важна и тестовая дисциплина: регулярно проводить учения по аварийному переключению, чтобы персонал знал, как действовать в реальной ситуации.

Еще одна частая причина проблем — недооценка влияния обновлений. Патчи и апдейты могут изменить поведение драйверов, сетевых модулей или механизмов репликации. Всегда тестируйте обновления в изолированной среде до разворачивания на проде и держите под рукой план отката. Не бойтесь временно снизить активность сервиса ради безопасности и надежности.

Пример конфигурации и практические детали

Представьте сборку, где внутри одного дата-центра разместились два узла сервера, каждый с дублированной цепью питания, двумя сетевыми картами в teaming, и RAID-массивом для локального хранения. Внешнюю доступность обеспечивает балансировщик нагрузки и система фейловера. В кластере Pacemaker вместе с Corosync решают, какие ресурсы перенести на соседний узел в случае отказа. Репликация данных ведется через быстрый сетевой канал на запасной узел, чтобы минимизировать потери в случае катастрофы.

В этом сценарии важна правильная настройка сетевых правил и политики консенсуса. Поддержка quorum и явное управление состояниями позволяют избежать ситуации, когда часть узлов считает себя живой, а другая часть — нет. Регулярные проверки целостности данных и тесты репликации создают уверенность в том, что переключение действительно незаметно для пользователей. Такой подход позволяет сохранять стабильность даже при сложных условиях эксплуатации, например, в периоды пиковых нагрузок или непредсказуемых сетевых сбоях.

Как измерять успех устойчивых решений

Успех сборки высокодоступного сервера оценивают по нескольким критериям. Уровень доступности сервиса, время восстановления после сбоев, и реальные задержки в критических сценариях — вот те показатели, которые нужно отслеживать постоянно. Важна прозрачная отчетность: показывайте данные по пропускной способности, латентности, времени переключения, а также экономическую эффективность развернутых решений. Вся эта информация помогает управлять рисками и планировать дальнейшее развитие инфраструктуры.

Не забывайте про эпизоды, когда отказ одного элемента постепенно влияет на другие компоненты. В подобных случаях помощь окажет детальная карта зависимостей и сценариев восстановления. Ваша цель — сделать так, чтобы любая неполадка визуально не влияла на пользователей и не требовала долгого ручного вмешательства. Чем более четко прописаны правила, тем быстрее система восстанавливается и тем меньше промежуточного простоя.

Путь к устойчивому сервису: культивируем экспертизу и опыт

Завершая обзор, можно сказать, что настоящая отказоустойчивость — это не набор патчей и схем, а дисциплина проектирования, тестирования и оперативного реагирования. Сборка высокодоступного сервера требует от команды четко выстроенных процессов, документированной архитектуры и культуры постоянного улучшения. В этом контексте каждый новый проект становится возможностью уточнить параметры доступности, усовершенствовать автоматизацию и уменьшить риски ненужных простоев.

Личный опыт подсказывает: чем раньше в проекте задуман подход к мониторингу и автоматизации, тем легче достигать поставленных целей. Я встречал множество случаев, где простая автоматизация процессов тестирования и регламентированные учения по аварийному переключению приносили выгоду уже на первых месяцах эксплуатации. Не бойтесь экспериментировать на тестовой среде и внедрять небольшие, управляемые улучшения, чтобы в реальных условиях они сработали без задержек и ошибок.

Наконец, помните: отказоустойчивость — это не одна конкретная технология, а совокупность решений, которые работают вместе. Понимание того, как ведут себя ваши узлы при сбоях, какое влияние оказывают задержки и какие компромиссы вы готовы принять, — вот ключ к реальному успеху. Ваша цель — не просто устранение отдельных пробелов, а создание целой экосистемы, где каждый элемент дополняет другой, сохраняя сервис в рабочем состоянии и позволяя бизнесу расти без лишних рисков.