Тестирование Xeon в многопоточных задачах: как увидеть реальную производительность и выбрать конфигурацию

Когда речь заходит о серверах и рабочих станциях для интенсивного параллелизма, процессоры Xeon часто становятся выбором по умолчанию. Но реальная производительность в многопоточных нагрузках редко соответствует громким обещаниям на витрине. Эта статья поможет не только понять, чем живет современный Xeon в условиях параллельного исполнения, но и показать практические шаги по измерению и интерпретации результатов без искажений. Мы разберем архитектурные особенности, методики тестирования, инструменты и реальные кейсы, которые встречаются в рабочих задачах — от научных вычислений до обработки больших данных и баз данных.

Архитектура Xeon и как она влияет на тесты

Современные линейки Xeon насчитывают множество поколений, каждое из которых имеет свои нюансы: число физических ядер, поддержка гиперпоточности, размер кэша и параметры памяти. Важная идея для тестирования в многопотоке — понимать, где заканчивается «теоретическая» мощь и начинается реальная пропускная способность. График масштабирования во многом зависит от того, как ядра обмениваются данными через кэш-иерархии и память, а также от того, как система распределяет задачи между NUMA-узлами.

Гиперпоточность (Hyper-Threading) может позволить лучше держать нагрузку на пиковых частотах за счет использования скрытых потоков в рамках одного физического ядра. Но не во всех задачах это даёт линейный прирост. В вычислительно нагруженных алгоритмах, требующих большого объема кэшированных данных, эффекты контекстного переключения и конкуренции за кешевые линии могут нивелировать часть преимуществ. Зато для задач с существенной пропускной способностью памяти и большой степенью распараллеливания Hyper-Threading часто приносит ощутимую пользу.

Не менее значим параметр памяти. Xeon-процессоры работают с памятью через NUMA-структуры, где доступ к локальной памяти узла дешевле, чем к удаленной. Поэтому грамотная настройка привязки потоков к узлам, правильный выбор политики распределения памяти и конкретных выделений памяти под задачи часто приносит больше прироста, чем дополнительная частота или более высокий тактовый режим. В реальном мире баланс между вычислениями и памятью — главный двигатель масштабирования.

План тестирования: от постановки задач до анализа результатов

Начинаем с постановки целей: что именно мы хотим проверить — линейное масштабирование по числу потоков, устойчивость к большим данным, латентность отдельных операций или суммарную Throughput. Четкая постановка позволяет выбрать релевантные бенчмарки и корректно интерпретировать полученные цифры. Далее составляем набор задач, который отражает реальные сценарии: это могут быть линейная алгебра, обработка больших массивов, запросы к базе данных и параллельная обработка мультимедийного контента.

Важно зафиксировать окружение: версия операционной системы, настройки энергопотребления, параметры turbo и частоты инициализации, режимы NUMA и политики распределения памяти. Перед тестами выполняем «разогрев» — прогоняем нагрузки, чтобы минимизировать влияние Cold Start и кэш-пустоты. Затем повторяем тесты с одинаковыми условиями несколькими запусками, чтобы оценить вариативность и исключить случайности.

После сбора данных следует рассчитать ключевые параметры: скорость масштабирования (speedup) по количеству потоков, эффективность использования ресурсов (efficiency), среднюю и пиковую Throughput, а также устойчивость на протяжении времени. Важной частью анализа становится поиск узких мест: не всегда ограничение идёт по процессору — зачастую виноваты структурные конкуренции за память, привязка потоков кNUMA-узлам или блокировки.

Практические тесты: последовательность нагрузок и примеры бенчмарков

Чтобы зафиксировать реальное поведение Xeon в многопоточной среде, выбираем набор нагрузок, который пересекается с реальными задачами. В качестве примеров можно взять параллельную обработку массивов, расчеты методом Монте-Карло, линейную алгебру и обработку данных в базах.

К каждому тесту важно прописать параметры: размер данных, количество потоков, режим энергопотребления, настройки памяти и привязку к NUMA. В таблицу ниже вынесены примеры нагрузок и ожидаемые направления масштабирования, которые часто встречаются в практике:

| Нагрузка | Характеристика масштабирования | Инструменты |

|---|---|---|

| Параллельная сортировка больших массивов | Хорошо масштабируется при грамотной привязке потоков и распараллеливании доступа к памяти; возможны огрехи из-за false sharing | OpenMP, TBB, Intel MKL, perf |

| Линейная алгебра (LU, QR, блочно-матричные операции) | Зависит от размера матриц и использования кэш-буферов; часто оновит по памяти, чем по вычислениям | Intel MKL, OpenBLAS, VTune, perf |

| Монте-Карло моделирование | Хорошая масштабируемость на уровне сотен потоков; арифметика простая, но требуется много рандомизации | OpenMP, CUDA для ускорителей, perf |

| Транзакционный guts баз данных | Зависит от архитектуры памяти и параллельной обработки запросов; узким местом часто становится конкурентность блока и журналирования | fio для нагрузок, sysbench, PCM, VTune |

Как показывает опыт, таблица поможет зафиксировать ожидаемую картину, но на практике реальная производительность в каждой задаче может отличаться из-за конкретной реализации алгоритмов, настроек компилятора и поведения операционной системы. Важно сосредоточиться на отношениях между количеством потоков и временем выполнения, а не на отдельных числах в тесте.

Инструменты и методики: как собирать результаты без искажений

Чтобы результат был полезен, нужно выбрать комбинацию инструментов, которые позволяют увидеть как вычислительную сторону, так и влияние памяти и взаимодействия потоков. Среди часто применяемых решений можно отметить Intel VTune Profiler для анализа горячих точек, памяти и блокировок; perf на Linux для агрегированных метрик и детального профилирования; PCM (Performance Counter Monitor) для контроля событий процессора и NUMA; а также LIKWID, который прост в настройке и хорошо подходит для тестирования памяти и топологии.

При подготовке к тестам рекомендуются следующие шаги: включение полного набора разрешений на счетчики производительности, фиксирование частоты процессора или ограничение до конкретного диапазона, явная привязка процессов к NUMA-узлам, а также исключение влияния фоновых процессов. Во время измерений полезно вести журнал параметров среды: версия BIOS, настройки C-states, параметры Turbo Boost и энергопотребления, чтобы можно было повторить эксперименты в другой момент времени.

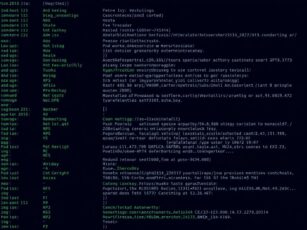

Примеры команд и методик (без копирования детальных инструкций) помогают держать процесс под контролем. Например, команды perf stat или perf record позволяют увидеть циклы, кэш-промахи и обращение к памяти; PCM — мониторинг частот, потребления и пропускной способности NUMA; VTune — визуализация горячих точек и анализ доминирующих функций. В случае параллельной нагрузки полезно сравнивать параметры до и после оптимизаций: привязка к узлам, изменения в параметрах сборки и настройка распределения памяти. Такой подход позволяет увидеть, где именно рождается узкое место: в вычислениях, в памяти или в синхронизации.

Ошибки и ловушки: false sharing, память и синхронизация

Одной из характерных ловушек является false sharing: когда потоки работают с данными, расположенными на одной и той же кэш-линии. Даже если каждый поток изменяет свою переменную, частая смена версии кэш-строки приводит к обильной синхронизации между ядрами и снижению эффективности. Решение простое: выравнивание структур под границу кэш-линий (обычно 64 байта) и аккуратное размещение рабочих партий данных.

Другие источники искажений — неравномерная привязка потоков к NUMA-узлам, нерелевантные режима энергопотребления и внезапные изменения частоты процессора в ходе теста. Важно фиксировать режимы работы и избегать сезонных колебаний частоты, связанных с тепловым режимом. Кроме того, не забывайте о контекстном переключении и конфликте за кеши в конкурентных структурах данных. Во избежание ложных выводов полезно строить тесты так, чтобы они имитировали реальное распределение задач между ядрами.

Еще одна распространенная ошибка — недооценка влияния повторяемости и вариативности исполнения. Результаты одних и тех же тестов на разных запусках могут различаться вплоть до десятков процентов. В таких случаях помогает увеличить число повторов и использовать статистические сводки: медиана, квартили и доверительные интервалы. Этот подход делает сравнение конфигураций более объективным.

Личный опыт и практические выводы

Лично мне приходилось сталкиваться с задачами, где правильная привязка потоков к NUMA-узлам давала заметный прирост быстрее, чем разгон частоты или добавление ядер. В работе с крупными матричными данными мы заметили, что именно размещение данных в локальной памяти узла приносит стабильно большее Throughput, чем попытки «раскачать» частоты во всех ядрах. В таких случаях удобно держать одну постоянную зону памяти под критические данные и запускать остальные потоки на соседних узлах. Результат — меньшее количество промахов TLB и более предсказуемое поведение.

Еще один урок — не забывать про архитектуру и конкретную модель Xeon. Поколение Cascade Lake, Ice Lake, Sapphire Rapids имеет разный набор опций для арифметических инструкций, кешей и канала памяти. Неправильная трактовка особенностей конкретной модели приводит к ложным ожиданиям — например, что увеличение числа ядер всегда сулит линейное ускорение. Реальная картина складывается из баланса между вычислениями, быстрой памятью и эффективной синхронизацией.

Из личного опыта следует держать под рукой несколько конфигураций стенда и план тестирования, чтобы быстро переходить от одной модели Xeon к другой. Небольшой набор тестов, повторяемый с учётом архитектурных особенностей, позволяет быстро получить полезную информацию для принятия решений по покупке серверов или настройке кластеров. И главное — не паниковать из-за отдельных отрицательных результатов. В реальном мире разные задачи ведут себя по-разному, и цель тестирования — понять, как устроена производительность именно для вашего сценария.

Рекомендации по выбору конфигураций Xeon для проектов

Если вы планируете работать с многопоточными задачами на Xeon, ориентируйтесь на баланс между количеством ядер, пропускной способностью памяти и топологией NUMA. Важные моменты:

- Определите требования к памяти и кэшу: какие данные будут держаться в памяти и насколько часто они будут попадать в кеш.

- Выбирайте конфигурацию с достаточным количеством локальной памяти на узле и разумной степенью межузельного обмена.

- Обратите внимание на поддержку Hyper-Threading в вашем сценарии: для сильно параллельных задач часто полезнее включить его, но в вычислительно ограниченных задачах эффект может быть минимальным.

- Настройте энергопотребление и режим Turbo так, чтобы тесты повторяемые, а результаты сравнимы между стендами и времени.

- Используйте современные инструменты для мониторинга и профилирования, чтобы идентифицировать узкие места и проверить влияние оптимизаций на реальную картину.

И в завершение — выбирая конфигурацию, планируйте не только характеристики процессора, но и связанные с ними компоненты: скорость памяти, пропускная способность шины кеша, количество каналов памяти и архитектуру сетевого взаимодействия. Только синергия этих факторов способна дать устойчивое повышение производительности в реальных рабочих задачах.

Таким образом, тестирование Xeon в многопоточных задачах — это не просто чтение очередных цифр в benchmark. Это целостный процесс, где важно понять архитектуру, корректно спроектировать нагрузку и внимательно анализировать результаты. Такой подход позволяет увидеть не просто «число на витрине», а реальное поведение системы в условиях, близких к тем, с которыми сталкиваются реальные проекты. Это и есть путь к принятию обоснованных решений о выборе сервера, настройке кластера и оптимизации приложений под конкретный железный профиль.